Le Progrès Industriel

L'instauration du repos hebdomadaire en France est l'un des piliers du droit du travail moderne. Enracinée dans la longue lutte des ouvriers pour obtenir de meilleures conditions de travail, la loi de 1906 instituant le repos hebdomadaire a marqué une étape clé dans la réglementation du temps de travail en France. Ce progrès social a non seulement amélioré la qualité de vie des travailleurs, mais a également jeté les bases du modèle français du bien-être au travail.

Le Contexte Historique et Social

Les conditions de travail avant le XXe siècle

Au XIXe siècle, avec l’essor de la révolution industrielle, les conditions de travail en France étaient particulièrement difficiles. La majorité des ouvriers, adultes comme enfants, travaillaient entre 12 et 16 heures par jour, six jours par semaine, souvent dans des conditions dangereuses et insalubres. Les dimanches, consacrés à la religion, étaient censés être un jour de repos, mais cette tradition ne suffisait pas à garantir un temps libre véritable pour les travailleurs. De plus, avec l'industrialisation, les entreprises devenaient de plus en plus réticentes à accorder un jour sans production.

La montée des revendications ouvrières

À mesure que la classe ouvrière se développait, les revendications pour de meilleures conditions de travail et une réduction du temps de travail se faisaient de plus en plus pressantes. Les mouvements sociaux et syndicaux, apparus au cours du XIXe siècle, mirent en avant la nécessité d'accorder aux travailleurs un temps de repos régulier. Le développement des syndicats ouvriers, comme la CGT (Confédération générale du travail), joua un rôle crucial dans la défense de ces droits.

La Loi de 1906 sur le Repos Hebdomadaire

La catastrophe de Courrières, un déclencheur

L'événement qui précipita la mise en place de la législation sur le repos hebdomadaire fut la catastrophe minière de Courrières, survenue en 1906. Ce tragique accident, qui coûta la vie à 1 099 mineurs, mit en lumière les conditions de travail déplorables des ouvriers et la nécessité urgente de réformes sociales. La population, émue par cette tragédie, poussa le gouvernement à accélérer les mesures en faveur des travailleurs.

Les débats parlementaires et l’adoption de la loi

Sous le gouvernement de Ferdinand Sarrien, soutenu par le ministre du Travail Georges Clemenceau, les discussions au Parlement sur l’instauration du repos hebdomadaire prirent de l’ampleur. Malgré les résistances de certains patrons d’industrie et commerçants, la loi du 13 juillet 1906 fut adoptée. Elle établissait pour la première fois en France le principe du repos hebdomadaire obligatoire, accordé en principe le dimanche.

Les Principes de la Loi

Un jour de repos obligatoire

La loi de 1906 stipulait que tous les salariés, dans les secteurs industriels et commerciaux, devaient bénéficier d’une journée complète de repos par semaine. Ce jour de repos devait être accordé de manière régulière, en principe le dimanche, jour traditionnel de repos dominical. L'objectif était d'améliorer le bien-être physique et mental des travailleurs, en leur permettant de se reposer et de se consacrer à des activités familiales ou religieuses.

Les exceptions et aménagements

Toutefois, la loi prévoyait des exceptions pour certaines professions, notamment celles nécessitant une activité continue, comme les hôpitaux, les transports et les services publics essentiels. Dans ces cas, des systèmes de repos compensateur pouvaient être mis en place, permettant de décaler le jour de repos à un autre moment de la semaine.

Les Réactions et Conséquences

Les réticences du patronat

L'institution du repos hebdomadaire ne fut pas immédiatement acceptée par tous. De nombreux patrons craignaient que cette mesure ne freine la productivité et n’entraîne des pertes financières. Les petits commerçants et artisans, en particulier, s’opposaient au repos obligatoire le dimanche, arguant que leur activité économique reposait en grande partie sur ce jour où les familles pouvaient faire leurs achats.

L'impact sur les conditions de travail

Malgré ces réticences, l’application de la loi eut des effets bénéfiques immédiats. Les travailleurs bénéficièrent pour la première fois d’un droit au repos régulier, ce qui permit une amélioration significative de la santé et du moral des ouvriers. Le repos hebdomadaire devint aussi un moyen de renforcer la cohésion familiale, en offrant aux travailleurs la possibilité de consacrer du temps à leurs proches et à leurs loisirs.

L’Évolution du Repos Hebdomadaire au XXe Siècle

Vers la semaine de cinq jours

L’instauration du repos hebdomadaire en 1906 ne marquait que le début d'une série de réformes visant à améliorer les conditions de travail en France. Au fil des décennies, de nouvelles avancées furent réalisées, notamment avec la réduction progressive du temps de travail et l’instauration des congés payés en 1936. La semaine de travail de cinq jours devint progressivement la norme dans les années 1950 et 1960, renforçant l’idée que le temps de repos était une composante essentielle du bien-être des travailleurs.

Les débats contemporains

Si le repos hebdomadaire reste aujourd'hui un droit acquis, les débats sur son aménagement continuent, notamment dans le secteur du commerce. La question de l'ouverture des magasins le dimanche est régulièrement au cœur des discussions politiques et sociales, soulevant des interrogations sur l'équilibre entre la vie professionnelle et la vie privée, ainsi que sur la compétitivité économique.

Une avancée majeure dans la reconnaissance des droits des travailleurs en France

L'institution du repos hebdomadaire en 1906 a marqué une avancée majeure dans la reconnaissance des droits des travailleurs en France. Cette mesure, inscrite dans un contexte de lutte sociale et de progrès, a transformé la manière dont le travail et le temps libre étaient perçus, en donnant aux ouvriers un droit fondamental au repos. Plus qu'un simple jour de pause, le repos hebdomadaire a contribué à redéfinir le rapport entre l'individu, le travail et la société, en plaçant la dignité humaine et le bien-être au centre des préoccupations.

Le premier vol entre la France et le Sénégal constitue un moment clé dans l'histoire de l'aviation mondiale et de la colonisation française en Afrique. Cet exploit technologique et humain a ouvert la voie à la création de liaisons aériennes intercontinentales, reliant l’Europe et l’Afrique de l’Ouest, favorisant ainsi les échanges économiques, culturels et politiques. Ce vol s’inscrit dans un contexte d'expansion coloniale et de développement de l’aviation civile et militaire après la Première Guerre mondiale.

Contexte historique

Dans les années 1920, l’aviation mondiale était en pleine évolution. Les grandes puissances, notamment la France, cherchaient à développer des réseaux aériens pour relier leurs colonies à la métropole. La connexion entre la France et le Sénégal, l'une des principales colonies de l’Afrique de l’Ouest, représentait un défi ambitieux qui symbolisait l’expansion de l’influence française sur ce continent.

L'Aviation Française après la Première Guerre Mondiale

Les prémices du développement aérien

Après la Première Guerre mondiale, la France sort de la guerre avec un secteur aéronautique en plein essor. Des innovations technologiques avaient été réalisées durant le conflit, notamment en matière de moteurs et de conception d’appareils. Cependant, l’objectif principal après la guerre était de transformer cet acquis militaire en un outil de communication et de transport civil.

L’ambition coloniale

La France avait un réseau étendu de colonies en Afrique de l’Ouest, et le Sénégal jouait un rôle central en tant que point stratégique. Dakar, la capitale, représentait une porte d’entrée vers l’Afrique et un point clé pour relier l’Europe à l’Amérique du Sud via des routes aériennes. L’idée d’établir une liaison aérienne régulière entre la France et Dakar, au Sénégal, est alors née dans les esprits des pionniers de l’aviation.

Les Pionniers et la Conception du Projet

Pierre-Georges Latécoère, un visionnaire

L’un des principaux artisans de ce projet fut Pierre-Georges Latécoère, un industriel français passionné d'aviation. Dès 1919, il entreprit de lancer la Compagnie Générale Aéropostale, une entreprise qui avait pour ambition de relier Toulouse à Dakar, puis l’Amérique du Sud. Pour Latécoère, l’aéronautique n’était pas seulement une technologie prometteuse mais également un moyen de relier les peuples et les cultures.

Les premiers essais

Les premières tentatives de vols transsahariens sont marquées par de nombreuses difficultés. Les conditions météorologiques extrêmes, le manque d’infrastructures adaptées et la distance à parcourir constituaient des obstacles majeurs. Cependant, l’esprit pionnier des aviateurs français et la volonté de repousser les limites permirent à ces projets de prendre forme.

Le Premier Vol entre la France et le Sénégal

La préparation du vol

Le premier vol direct entre la France et le Sénégal fut réalisé par l’Aéropostale, dans le cadre des liaisons postales transsahariennes. Avant cette première liaison, plusieurs étapes de reconnaissance et de préparation avaient été menées pour identifier les meilleures routes et garantir la sécurité des équipages.

Le départ de Toulouse

Le 1er septembre 1925, un avion Bréguet 14, piloté par Jean Mermoz, décolle de Toulouse avec pour mission de rejoindre Dakar. Mermoz, qui deviendra par la suite l’un des aviateurs les plus célèbres de son époque, joua un rôle central dans cette expédition aérienne.

Une traversée pleine de défis

Le vol, qui traversa le désert du Sahara, fut marqué par des conditions extrêmes. Les températures élevées, les tempêtes de sable, ainsi que l'isolement des équipages en cas de panne étaient autant de difficultés à surmonter. Le premier vol dura plusieurs jours, avec des escales techniques, mais atteignit finalement Dakar, marquant ainsi la première liaison aérienne réussie entre la France et le Sénégal.

Les Conséquences de ce Premier Vol

Une avancée technologique majeure

Ce vol démontra la faisabilité des liaisons aériennes longues distances entre l’Europe et l’Afrique. Le succès de cette mission permit de renforcer la confiance dans les capacités techniques des appareils de l’époque, ouvrant la voie à l’établissement de vols réguliers pour le courrier et les passagers.

L’impact sur les relations franco-africaines

Sur le plan politique et économique, ce vol renforça la domination coloniale française en Afrique. En connectant les colonies africaines à la métropole par voie aérienne, la France consolidait son contrôle sur les territoires et facilitait la circulation des biens, des ressources et des informations.

L'Héritage du Premier Vol

L’essor de l’aéropostale

Le succès du vol entre la France et le Sénégal marque le début d’une série de développements pour l’Aéropostale. Très rapidement, des lignes régulières furent établies, et la liaison Toulouse-Dakar devint un axe stratégique pour la poste aérienne et les communications entre les continents.

La naissance d’une légende

Les aviateurs qui prirent part à ces premiers vols, tels que Jean Mermoz et Antoine de Saint-Exupéry, sont aujourd'hui des figures légendaires de l'aviation. Ils ont non seulement contribué au développement technique de l’aviation, mais également à une vision romantique et héroïque du métier de pilote, immortalité dans la littérature et l’histoire de l’aviation.

Une Étape Cruciale dans l’Histoire de l’Aviation

Le premier vol entre la France et le Sénégal fut un événement marquant qui symbolisa l’audace et l’innovation de l’époque. Ce vol transsaharien, malgré ses nombreux défis, ouvrit une nouvelle ère pour l’aviation et renforça les liens entre l’Europe et l’Afrique. Il témoigne de l’esprit pionnier des aviateurs qui, au péril de leur vie, ont contribué à rapprocher les continents et à écrire une nouvelle page de l’histoire mondiale.

Le 9 octobre 1890, l'histoire de l'aviation mondiale franchit une étape décisive avec le premier vol motorisé de l'Éole, un avion conçu par l'ingénieur français Clément Ader. Ce vol, bien que court et modeste, constitue une avancée majeure dans le développement de l'aéronautique. L'Éole, avec sa conception novatrice et son moteur à vapeur, est un symbole de l'innovation technologique et de la vision avant-gardiste d'Ader, un pionnier de l'aviation. Ce chapitre marquant est souvent considéré comme l'un des premiers pas vers l'avènement de l’aviation moderne.

Clément Ader, un Visionnaire de l’Aviation

L'ingénieur et inventeur

Né en 1841 à Muret, en France, Clément Ader était un ingénieur et inventeur passionné par les nouvelles technologies. Après avoir travaillé dans les domaines de l'électricité et de la téléphonie, Ader s'intéressa de près à l'idée du vol humain. Inspiré par les ailes des chauves-souris, il commença à concevoir des machines volantes dès les années 1870, persuadé que l'aviation motorisée était la clé pour conquérir le ciel.

Les inspirations d'Ader : la nature et la mécanique

Ader était fasciné par la nature, en particulier par les ailes des oiseaux et des chauves-souris, qu’il voyait comme des modèles parfaits pour la conception d’aéronefs. Cette observation minutieuse de la nature lui permit de concevoir des machines avec des ailes articulées, un concept qui marqua la naissance de l'Éole.

La Conception de l'Éole

Un projet audacieux

L'Éole, le premier avion motorisé d’Ader, tire son nom du dieu des vents dans la mythologie grecque. Conçu entre 1886 et 1890, cet appareil révolutionnaire mesurait 14 mètres d'envergure et pesait environ 300 kilogrammes. Sa structure en bois et en toile, associée à un moteur à vapeur de 20 chevaux conçu par Ader lui-même, était une prouesse technique pour l’époque.

L'inspiration animale

L'une des caractéristiques les plus originales de l'Éole est la forme de ses ailes. Ader s'inspira des ailes des chauves-souris, leur donnant une forme légèrement incurvée, ce qui, selon lui, permettait une meilleure portance et une plus grande maniabilité dans les airs. Ce biomimétisme reflétait sa volonté de s'appuyer sur la nature pour résoudre les défis de l'aviation.

Le moteur à vapeur

L'une des innovations majeures de l'Éole réside dans son moteur. Contrairement aux autres expérimentateurs qui utilisaient des moteurs à combustion interne, Ader opta pour un moteur à vapeur léger et puissant. Ce moteur, équipé d'une hélice située à l'avant de l'avion, fut conçu pour générer suffisamment de poussée pour soulever l'appareil du sol.

Le Premier Vol de l'Éole

Le 9 octobre 1890, un vol historique

Le 9 octobre 1890, Clément Ader réussit un exploit extraordinaire : l'Éole s’éleva du sol à une hauteur de quelques dizaines de centimètres et parcourut une distance d’environ 50 mètres. Bien que ce vol ait été modeste en termes de distance et de hauteur, il s'agissait d'une réalisation sans précédent, puisqu’il s’agissait du premier vol motorisé répertorié de l’histoire.

Une performance en demi-teinte

Le vol de l'Éole fut de courte durée et incontrôlé, car l'appareil ne disposait pas de dispositifs de contrôle en vol (gouvernes). Ader n'avait pas encore résolu le problème de la stabilité et de la direction, mais ce vol démontra que le principe du vol motorisé était réalisable. Bien qu'il ne fût pas largement reconnu à l’époque, ce premier vol ouvrit la voie à d'autres expérimentations.

Les Conséquences et l'Impact sur l'Aviation

Le début d'une nouvelle ère

Le vol de l'Éole marqua les prémices d'une nouvelle ère dans l'histoire de l'aviation. Bien que les résultats soient restés limités à l’époque, ce premier décollage motorisé démontra que l'aviation n'était plus un rêve inaccessible. Ader posa les bases pour les développements futurs en prouvant que la propulsion motorisée pouvait permettre à une machine plus lourde que l'air de quitter le sol.

La reconnaissance tardive de l'innovation

Malgré cet exploit historique, Clément Ader ne reçut pas immédiatement la reconnaissance qu'il méritait. À la fin du XIXe siècle, le domaine de l'aéronautique en était encore à ses balbutiements, et les progrès réalisés par d'autres pionniers comme les frères Wright éclipsèrent en partie ses contributions. Cependant, au fil du temps, l'œuvre d'Ader a été réévaluée, et il est aujourd'hui reconnu comme un pionnier de l'aviation.

Les Projets Ultérieurs d’Ader et l’Évolution de l’Aviation

L'Aviation II et l'Aviation III

Suite au premier vol de l'Éole, Clément Ader continua ses travaux en construisant deux autres modèles d'avions, connus sous les noms d'Aviation II et Aviation III. Ces machines étaient plus grandes et plus puissantes que l'Éole, et Ader espérait qu'elles permettraient des vols plus longs et plus contrôlés. Cependant, malgré ses efforts, Ader ne réussit pas à faire voler ces appareils de manière significative, et son projet fut progressivement abandonné.

Le soutien du gouvernement français

À la fin du XIXe siècle, les travaux d’Ader commencèrent à attirer l’attention des autorités militaires françaises. En 1898, il fut même soutenu par le ministère de la Guerre, qui voyait dans l'aviation un potentiel stratégique pour l'armée. Malgré cet appui, Ader ne parvint pas à démontrer pleinement l'efficacité de ses appareils, et le projet fut finalement annulé en 1900 après une série d’échecs lors des essais.

L'Héritage de Clément Ader

Une vision avant-gardiste

Malgré ses échecs ultérieurs, Clément Ader reste un visionnaire qui a ouvert la voie à l’aviation moderne. Ses travaux ont influencé de nombreux ingénieurs et inventeurs, et son approche basée sur la biomimétique (l’étude des formes naturelles pour les reproduire en ingénierie) a marqué un tournant dans la conception des aéronefs.

L'influence sur les pionniers de l'aviation

Les pionniers de l’aviation au début du XXe siècle, tels que les frères Wright, ont eux aussi bénéficié des avancées réalisées par Clément Ader. Bien qu’ils aient pris une direction différente en termes de conception, ils s’inspirèrent des expérimentations d’Ader pour parfaire leurs propres appareils. Les travaux d’Ader constituèrent ainsi une pierre angulaire pour le développement des avions à moteur contrôlables.

La reconnaissance posthume

Ce n’est que bien après sa mort en 1925 que Clément Ader fut pleinement reconnu pour ses contributions à l’histoire de l’aviation. Aujourd’hui, plusieurs musées, rues et aéroports portent son nom, et son avion Éole est exposé au Musée des Arts et Métiers à Paris, où il est considéré comme une pièce maîtresse de l'histoire de l'aéronautique.

Un moment clé dans l'histoire de l'aviation mondiale

Le premier vol de l’Éole en 1890 représente un moment clé dans l'histoire de l'aviation mondiale. Bien que ce vol ait été court et peu contrôlé, il ouvrit la voie à de nombreuses innovations qui allaient révolutionner le transport aérien. Clément Ader, avec sa vision audacieuse et ses innovations technologiques, posa les bases de l’aéronautique moderne. Son travail sur l'Éole, ses tentatives ultérieures avec l'Aviation II et III, ainsi que son influence sur les générations suivantes de pionniers font de lui l'une des figures incontournables de l’histoire de l'aviation.

Dans l'imaginaire collectif, l’automobile est souvent associée aux moteurs à essence, à des figures comme Henry Ford et à l’industrie pétrolière. Pourtant, les origines de l’automobile sont bien plus diversifiées. Saviez-vous qu'en 1884, soit plus de deux décennies avant la généralisation des voitures à essence, la première voiture électrique était déjà en production ? Cet événement représente une étape importante et souvent oubliée de l’histoire américaine et mondiale de l’automobile. Dans cet article, nous allons explorer l’histoire de cette invention, ses impacts et les raisons pour lesquelles elle n’a pas dominé l’industrie automobile dès ses débuts.

Les Origines de la Voiture Électrique

L'innovation de Thomas Parker en 1884

En 1884, l'ingénieur britannique Thomas Parker est crédité de la production de l’une des premières voitures électriques. Bien que son invention ait eu lieu en Angleterre, elle eut un impact majeur sur l’évolution des technologies électriques aux États-Unis. Parker, pionnier dans l'électrification des transports publics à Londres, appliqua ses compétences à la conception d'un véhicule capable de se déplacer à l'aide d'une batterie rechargeable.

Le Contexte des Années 1880 aux États-Unis

À la même époque, les États-Unis vivent une période d'industrialisation rapide et d'innovations technologiques. Des figures comme Thomas Edison et Nikola Tesla travaillent sur des avancées dans le domaine de l’électricité. Les premières voitures fonctionnant à la vapeur ou à l'essence faisaient également leur apparition, mais l’idée de véhicules électriques gagnait en popularité dans les milieux scientifiques et ingénieurs.

L’Avancée de la Technologie Électrique aux États-Unis

Les Pionniers Américains de la Voiture Électrique

Les années qui suivirent la création de la première voiture électrique virent l’émergence d’inventeurs américains qui adaptèrent et améliorèrent cette technologie. Parmi eux, William Morrison, un inventeur originaire de l'Iowa, est crédité de la création de la première voiture électrique américaine en 1890. Son véhicule, capable de transporter jusqu'à six personnes et d'atteindre une vitesse de 20 km/h, démontrait déjà le potentiel des véhicules électriques à grande échelle.

La Popularité Croissante des Voitures Électriques

À la fin du XIXe siècle et au début du XXe, les voitures électriques devinrent de plus en plus populaires aux États-Unis, notamment dans les grandes villes. Elles étaient silencieuses, ne produisaient pas d’émissions et, contrairement aux véhicules à essence, ne nécessitaient pas de manivelle pour être démarrées. Cela les rendait particulièrement attrayantes pour les riches citadins et les femmes, qui trouvaient plus simple de les conduire.

Les Avantages et Limites des Voitures Électriques

Les Avantages Techniques

L'un des principaux avantages des voitures électriques à la fin du XIXe siècle résidait dans leur simplicité de fonctionnement. Contrairement aux moteurs à vapeur, qui nécessitaient du temps pour chauffer, ou aux moteurs à essence, qui étaient bruyants et peu fiables, les voitures électriques étaient faciles à utiliser. De plus, elles n’émettaient pas de fumées nocives, ce qui en faisait un choix idéal pour les zones urbaines.

Les Limites de l'Autonomie

Cependant, la principale faiblesse des voitures électriques de l’époque était leur faible autonomie. Les batteries de l’époque étaient lourdes et ne permettaient qu’une distance limitée, souvent inférieure à 50 kilomètres. De plus, le réseau de recharge était inexistant, ce qui limitait fortement leur utilisation hors des villes.

Le Déclin Temporaire de la Voiture Électrique

La Montée en Puissance des Voitures à Essence

Au début du XXe siècle, les innovations dans les moteurs à combustion interne, notamment l’introduction par Henry Ford de la Ford Model T en 1908, changèrent la donne. Produite en masse et vendue à un prix abordable, la Model T rendit les voitures à essence accessibles à la classe moyenne américaine. De plus, l'infrastructure pétrolière, avec l’apparition des stations-service, favorisa la montée en puissance de ces véhicules, au détriment des voitures électriques.

L’Essor de l’Industrie Pétrolière

Le développement de l'industrie pétrolière aux États-Unis, en particulier avec la découverte de vastes réserves de pétrole au Texas et ailleurs, contribua à la domination des véhicules à essence. Le carburant bon marché, couplé à une autonomie bien supérieure, rendit les voitures électriques moins attractives, malgré leurs avantages environnementaux et pratiques en ville.

Le Renouveau de la Voiture Électrique

Les Crises Pétrolières et la Redécouverte des Véhicules Électriques

Il fallut attendre les crises pétrolières des années 1970 et la prise de conscience croissante des problèmes environnementaux pour que les voitures électriques fassent leur retour. L’instabilité des prix du pétrole et la pollution croissante des grandes villes remirent en question la dépendance vis-à-vis des combustibles fossiles. Ainsi, les chercheurs et les constructeurs commencèrent à explorer de nouveau le potentiel des véhicules électriques.

L’Évolution Technologique au XXIe Siècle

Avec l’avènement de nouvelles technologies de batteries, notamment les batteries lithium-ion, et l'émergence de marques comme Tesla au début des années 2000, les voitures électriques ont connu une véritable renaissance. L’autonomie a augmenté, les performances se sont améliorées, et un réseau mondial de bornes de recharge a vu le jour, rendant ces véhicules plus pratiques et viables.

Des ingénieurs et inventeurs visionnaires

L’histoire de la voiture électrique commence bien avant l'essor de Tesla ou d'autres véhicules électriques modernes. Dès 1884, des ingénieurs et inventeurs visionnaires ont ouvert la voie à ce qui est aujourd’hui considéré comme l’avenir de l’automobile. Même si la technologie a mis plus d'un siècle à s'imposer, les premières voitures électriques témoignent de l'ingéniosité et de la persévérance de ces pionniers.

Aujourd’hui, dans un monde confronté au défi du changement climatique, la voiture électrique représente une solution prometteuse pour un avenir plus durable, renouant avec une histoire souvent oubliée, mais essentielle. De Thomas Parker à Elon Musk, l’évolution de la voiture électrique illustre à quel point les inventions du passé peuvent modeler le futur.

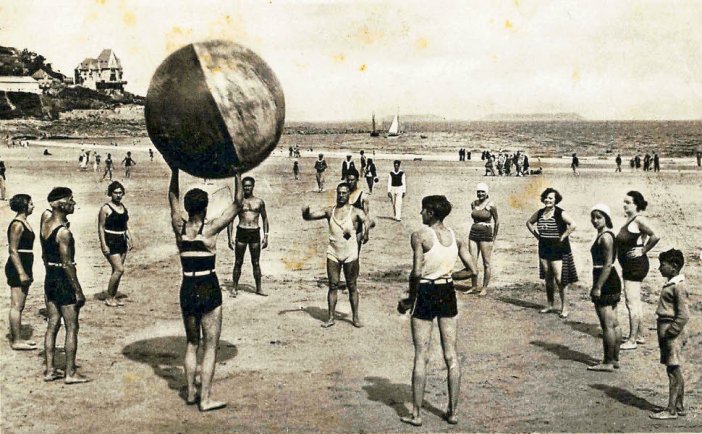

Les congés payés représentent un droit essentiel pour les travailleurs, offrant la possibilité de se reposer et de se ressourcer tout en bénéficiant d'une rémunération. L'histoire des congés payés témoigne de l'évolution des droits des travailleurs et des changements sociétaux. Cet article explore l'origine des congés payés, leur évolution, leur impact sur la société et les défis actuels auxquels ils sont confrontés.

Histoire des Congés Payés

Les débuts du droit aux congés

L'idée des congés payés a émergé au cours du 19ème siècle, à une époque où les conditions de travail étaient souvent difficiles. Les ouvriers travaillaient de longues heures sans interruption, et les maladies et les accidents de travail étaient fréquents. Les mouvements ouvriers ont commencé à revendiquer des droits, dont celui de bénéficier de temps de repos.

L’instauration légale

C’est en France, en 1936, que les congés payés ont été officialisés avec les Accords de Matignon, permettant aux travailleurs de bénéficier de deux semaines de congés annuels payés. Cette avancée a été le fruit de luttes sociales et a marqué un tournant dans les droits des travailleurs. D’autres pays ont rapidement emboîté le pas, adaptant des lois similaires.

Les Congés Payés dans le Monde

Législation internationale

À l'échelle mondiale, la question des congés payés est abordée par l'Organisation Internationale du Travail (OIT), qui recommande des normes minimales pour la protection des travailleurs. Cependant, la durée et les conditions des congés varient considérablement d'un pays à l'autre, reflétant des contextes culturels et économiques différents.

Comparaisons régionales

- Europe : La plupart des pays européens offrent au moins quatre semaines de congés payés par an, avec des variations selon les législations nationales. La France, par exemple, est connue pour ses généreux congés payés, qui peuvent atteindre cinq semaines ou plus.

- États-Unis : En revanche, les États-Unis ne disposent pas de législation fédérale garantissant des congés payés, laissant cette question à la discrétion des employeurs. Cela a conduit à de grandes disparités dans l'accès aux congés payés.

L'Impact des Congés Payés sur la Société

Sur la santé et le bien-être

Les congés payés jouent un rôle crucial dans la santé mentale et physique des travailleurs. Des études montrent que prendre des congés réguliers réduit le stress, améliore la productivité et favorise un meilleur équilibre entre vie professionnelle et vie personnelle. Un repos adéquat permet également de prévenir le burnout et d'améliorer la satisfaction au travail.

Conséquences économiques

Sur le plan économique, les congés payés peuvent également bénéficier aux entreprises. Les travailleurs reposés sont souvent plus productifs, et les congés peuvent stimuler l'économie locale par le biais du tourisme et des loisirs. Les périodes de congé peuvent également entraîner une augmentation de la consommation, contribuant ainsi à la croissance économique.

Défis Contemporains

Les inégalités d'accès

Malgré les avancées, des inégalités persistent en matière d'accès aux congés payés. Les travailleurs précaires, les freelances et les employés à temps partiel ont souvent des droits limités. Les différences entre les secteurs d'activité aggravent également cette situation.

L'impact de la pandémie de COVID-19

La pandémie de COVID-19 a mis en lumière les défis des congés payés. De nombreux travailleurs ont été contraints de prendre des congés sans solde ou de travailler à distance, soulevant des questions sur la protection des droits des travailleurs en période de crise. Les discussions sur les congés payés ont pris une nouvelle dimension, mettant en avant l'importance d'une protection sociale renforcée.

L'Avenir des Congés Payés

Évolutions législatives

Le paysage des congés payés continue d'évoluer. Dans plusieurs pays, des mouvements sociaux et politiques plaident pour l'extension des congés payés, l'égalité des droits et des protections accrues pour tous les travailleurs. Des initiatives récentes visent à intégrer des congés parentaux, des congés pour deuil et des congés pour soins aux proches dans le cadre des droits des travailleurs.

Vers une nouvelle culture du travail

Le futur des congés payés pourrait également être influencé par des changements culturels au sein des entreprises. De plus en plus, les organisations adoptent des politiques de bien-être et d'équilibre travail-vie personnelle, considérant les congés payés non seulement comme un droit, mais comme un élément stratégique pour attirer et retenir les talents.

Conclusion : Un Droit Essentiel à Préserver

Les congés payés sont un droit fondamental qui témoigne de la lutte pour le bien-être des travailleurs. Alors que des progrès significatifs ont été réalisés au fil des décennies, des défis subsistent. Il est essentiel de continuer à défendre ce droit, en veillant à ce qu'il soit accessible à tous et adapté aux évolutions du monde du travail. Dans un contexte où la santé mentale et le bien-être au travail sont de plus en plus prioritaires, les congés payés demeurent un élément clé d'une société équitable et prospère.

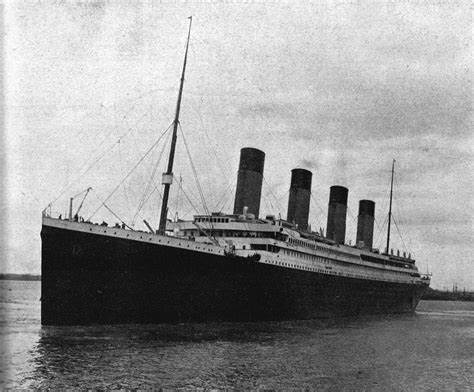

Le naufrage du Titanic, dans la nuit du 14 au 15 avril 1912, reste l'un des événements maritimes les plus marquants de l'histoire moderne. Connu pour être le plus grand et le plus luxueux paquebot de son époque, il était réputé insubmersible. Pourtant, lors de son voyage inaugural, il heurta un iceberg dans l'Atlantique Nord, provoquant la perte de plus de 1 500 vies. Ce drame a marqué un tournant dans l’histoire de la navigation maritime et a laissé une empreinte indélébile dans la mémoire collective. Cet article revient sur les circonstances du naufrage, les erreurs fatales commises, et les leçons tirées de cette tragédie.

Le Titanic, un Paquebot de Luxe

La construction du Titanic : Un chef-d’œuvre d’ingénierie

Le Titanic fut construit par les chantiers navals Harland & Wolff à Belfast, en Irlande du Nord, pour la White Star Line. Achevé en 1912, il mesurait environ 269 mètres de long, pesait 46 000 tonnes et possédait une capacité d’accueil de plus de 2 200 passagers et membres d’équipage. Il représentait l’apogée de la technologie maritime, avec des innovations telles que des compartiments étanches et un double fond censé le rendre pratiquement insubmersible.

Un luxe inégalé à bord

Le Titanic n'était pas seulement un exploit technique, mais aussi un symbole de luxe et d’opulence. Les cabines de première classe étaient somptueusement décorées, avec des salles de réception, des restaurants gastronomiques, une piscine, une salle de sport, et même un bain turc. Le paquebot était conçu pour offrir un confort maximal à ses passagers les plus riches, tout en transportant des immigrants de troisième classe, venus chercher une vie meilleure en Amérique.

Le Voyage Inaugural et la Collision avec l'Iceberg

Le départ de Southampton vers New York

Le Titanic a quitté le port de Southampton, en Angleterre, le 10 avril 1912, à destination de New York. Après des escales à Cherbourg, en France, et à Queenstown (aujourd'hui Cobh), en Irlande, il s’aventure dans l’Atlantique Nord. À son bord, des célébrités, des hommes d’affaires et des passagers de tous horizons. L’optimisme règne à bord, et personne ne se doute du drame à venir.

La nuit du drame : La collision fatale avec l’iceberg

Dans la nuit glaciale du 14 avril 1912, vers 23h40, alors que le Titanic naviguait à pleine vitesse à travers les eaux dangereuses de l’Atlantique Nord, il percuta un iceberg. Le choc fut si subtil que certains passagers de première classe ne le remarquèrent même pas. Pourtant, sous l’eau, l’iceberg avait gravement endommagé la coque du paquebot, ouvrant plusieurs compartiments étanches et scellant ainsi son destin.

Le Naufrage et l’Opération de Sauvetage

Les premières heures après la collision

Quelques minutes après la collision, l’équipage réalisa que les dommages étaient catastrophiques. L’ingénieur en chef, Thomas Andrews, informa le capitaine Edward Smith que le Titanic était condamné à couler en quelques heures. Les compartiments étanches, qui auraient pu maintenir le bateau à flot s'ils étaient touchés séparément, furent percés sur une trop grande longueur, provoquant un afflux d'eau irréversible.

Le manque de canots de sauvetage

L’un des facteurs aggravants de cette tragédie fut l'insuffisance de canots de sauvetage à bord. Le Titanic ne possédait que 20 canots, capables d’accueillir environ 1 200 personnes, alors qu'il transportait plus de 2 200 passagers et membres d'équipage. Cette situation était due aux normes de sécurité de l’époque, basées sur le tonnage du navire plutôt que sur le nombre de passagers.

Les évacuations chaotiques

L’évacuation du navire fut chaotique, aggravée par la confusion et la panique à bord. De nombreux canots de sauvetage furent lancés à l’eau à moitié remplis. Les règles de priorité “les femmes et les enfants d’abord” furent appliquées de manière inégale, et les passagers de troisième classe, situés dans les compartiments inférieurs du navire, furent les plus nombreux à périr dans la catastrophe.

Le Naufrage et la Tragédie Humaine

Le Titanic disparaît sous les eaux

À 2h20 du matin, environ deux heures et quarante minutes après la collision, le Titanic se brisa en deux avant de sombrer dans les profondeurs de l’Atlantique Nord. La plupart des passagers encore à bord furent plongés dans les eaux glacées, où l’hypothermie devint rapidement fatale. Sur les 2 200 personnes à bord, seules 706 survécurent, principalement grâce aux canots de sauvetage.

4.2 Le rôle du Carpathia

Le RMS Carpathia, un navire qui naviguait à proximité, reçut les appels de détresse du Titanic et se dirigea immédiatement vers les lieux du naufrage. Cependant, il n'arriva que plusieurs heures après la disparition du paquebot, ne pouvant sauver que les survivants déjà dans les canots de sauvetage. Le Carpathia transporta les rescapés jusqu'à New York, où ils furent accueillis par une vague de solidarité internationale.

Les Conséquences et Répercussions du Naufrage

Les enquêtes et les réformes de sécurité maritime

Le naufrage du Titanic suscita une onde de choc mondiale et donna lieu à plusieurs enquêtes menées au Royaume-Uni et aux États-Unis. Les investigations révélèrent de nombreuses erreurs humaines, tant dans la conception du navire que dans la gestion de la catastrophe. En conséquence, des réformes majeures furent adoptées, notamment la création de nouvelles règles internationales sur les canots de sauvetage, la surveillance des icebergs, et l’amélioration des systèmes de communication en mer.

La Convention SOLAS (Safety of Life at Sea)

En 1914, la Convention internationale pour la sauvegarde de la vie humaine en mer (SOLAS) fut adoptée, imposant de nouvelles normes de sécurité pour les navires. Parmi les changements significatifs figuraient l’obligation pour tous les navires de disposer d’un nombre suffisant de canots de sauvetage pour l’ensemble des passagers, l’instauration d’une veille radio permanente à bord des navires, et la surveillance des zones à risques comme celle des icebergs.

L’Héritage du Titanic

Le Titanic dans la culture populaire

Le naufrage du Titanic a fasciné des générations entières et a inspiré de nombreuses œuvres culturelles, dont des films, des livres et des expositions. Parmi les plus célèbres, le film de James Cameron, Titanic (1997), est devenu un phénomène mondial, capturant l’imaginaire du public et perpétuant la mémoire de cette tragédie. Le Titanic symbolise à la fois les rêves de progrès technologique et les dangers de l’arrogance humaine face à la nature.

Les recherches archéologiques et la découverte de l’épave

L’épave du Titanic fut découverte en 1985 par l’équipe de Robert Ballard, à une profondeur de 3 800 mètres dans l’Atlantique Nord. Cette découverte marqua le début de recherches archéologiques sous-marines, permettant de mieux comprendre les causes du naufrage et de découvrir des objets du quotidien laissés par les passagers. Les expéditions scientifiques qui ont suivi ont permis de préserver la mémoire du Titanic tout en révélant des détails historiques oubliés.

Conclusion : Une Tragédie Inoubliable

Le naufrage du Titanic continue d’émouvoir et de captiver les esprits plus de 100 ans après la catastrophe. Ce drame humain, marqué par les erreurs de jugement, la technologie imparfaite et la force impitoyable de la nature, reste un rappel poignant des dangers de la mer et des limites de l’arrogance humaine. L’héritage du Titanic se manifeste non seulement dans les réformes de sécurité maritime, mais aussi dans la mémoire collective mondiale, où son histoire demeure un symbole de la fragilité de la vie et de l’importance des leçons tirées du passé.

Le Titanic, un paquebot emblématique surnommé le « navire insubmersible », est devenu tristement célèbre pour avoir coulé lors de son voyage inaugural en avril 1912. Sa fin tragique a marqué l'histoire maritime et continue de fasciner des générations. Ce drame a entraîné une remise en question des normes de sécurité en mer et a laissé une empreinte durable dans la culture populaire. Ce géant des mers représentait l'apogée de la technologie navale de son époque, mais son naufrage, causant la mort de plus de 1 500 personnes, révèle les dangers de l'arrogance face à la nature.

Conception et Construction du Titanic

Un projet titanesque

Le Titanic a été conçu par la société White Star Line pour être le paquebot le plus luxueux et le plus grand jamais construit. Son lancement faisait partie d'une stratégie de compétition avec la Cunard Line, une compagnie rivale, qui avait construit deux paquebots rapides, le Lusitania et le Mauretania. Afin de se démarquer, la White Star Line décida de miser sur la taille et le luxe plutôt que la vitesse.

La construction à Belfast

La construction du Titanic débuta en 1909 dans les chantiers navals Harland & Wolff à Belfast, en Irlande du Nord. Ce fut une tâche titanesque qui nécessita plus de trois ans de travail. Le Titanic mesurait 269 mètres de long et pesait 46 328 tonnes. Ses infrastructures somptueuses comprenaient des salles à manger luxueuses, des salons de style victorien, des bains turcs et même une piscine. Le navire était équipé des technologies les plus avancées de l’époque, y compris des compartiments étanches censés le rendre insubmersible.

Le Voyage Inaugural

Le départ de Southampton

Le Titanic quitta Southampton, en Angleterre, le 10 avril 1912, pour son voyage inaugural à destination de New York. À bord se trouvaient environ 2 200 passagers et membres d'équipage, un mélange de riches et célèbres, de migrants cherchant une nouvelle vie en Amérique, et de membres de l'équipage fiers de servir sur le plus grand paquebot du monde. Parmi les passagers de première classe figuraient des noms prestigieux tels que John Jacob Astor IV, Benjamin Guggenheim et Isidor Straus.

Les jours en mer

Les premiers jours du voyage se déroulèrent sans incident, et la traversée fut marquée par le luxe et le confort offerts aux passagers de première classe, tandis que ceux de troisième classe bénéficiaient de meilleures conditions que sur la plupart des autres navires. Le Titanic naviguait à une vitesse moyenne de 21 nœuds, bien que le capitaine Edward Smith eût reçu plusieurs avertissements concernant la présence d’icebergs dans la région qu’ils allaient traverser.

La Nuit du Naufrage

La collision avec l'iceberg

Le 14 avril 1912, à 23h40, le Titanic heurta un iceberg dans l'Atlantique Nord. L’impact se produisit sur le flanc droit du navire, endommageant cinq de ses compartiments étanches. Bien que le Titanic ait été conçu pour survivre à des dommages affectant jusqu'à quatre compartiments, la défaillance du cinquième fut fatale. Rapidement, l'eau commença à s'engouffrer dans le navire.

L’évacuation chaotique

Après la collision, le capitaine Smith réalisa l’ampleur du désastre et ordonna l'évacuation du navire. Cependant, le Titanic ne disposait que de 20 canots de sauvetage, suffisants pour seulement la moitié des passagers à bord. Les procédures de sauvetage étaient mal organisées, avec des canots souvent envoyés à moitié vides. De plus, la politique « les femmes et les enfants d’abord » provoqua la panique parmi les passagers masculins. Le paquebot coula par l’avant, se brisant en deux avant de disparaître sous les flots à 2h20 du matin le 15 avril 1912.

Les Survivants et les Secours

Le rôle du RMS Carpathia

Le RMS Carpathia, un autre paquebot de la compagnie Cunard, répondit à l’appel de détresse du Titanic et arriva sur les lieux vers 4h du matin, deux heures après le naufrage. Il parvint à secourir les 705 survivants qui avaient réussi à embarquer dans les canots de sauvetage. Le reste des passagers, environ 1 500 personnes, périrent dans les eaux glaciales de l’Atlantique Nord, principalement en raison de l’hypothermie.

Le traumatisme des survivants

Les survivants du Titanic, malgré leur sauvetage, furent profondément marqués par cette tragédie. Beaucoup furent incapables de se remettre de la perte de proches ou des conditions traumatisantes qu’ils avaient vécues cette nuit-là. Des enquêtes menées à la suite de l'accident, tant aux États-Unis qu’au Royaume-Uni, permirent de mieux comprendre les causes du naufrage et de recommander des améliorations dans les normes de sécurité maritime.

Les Conséquences du Naufrage

Changements dans la réglementation maritime

Le naufrage du Titanic entraîna une série de réformes maritimes majeures. La principale fut la création en 1914 de la Convention internationale pour la sauvegarde de la vie humaine en mer (SOLAS), qui imposait des normes plus strictes en matière de canots de sauvetage, de formation des équipages et de communications en mer. Les navires furent également équipés de radios fonctionnant en permanence, afin de pouvoir répondre immédiatement aux appels de détresse.

L’impact culturel et mémoriel

Le naufrage du Titanic a captivé l'imagination populaire dès le moment où il est survenu. Il a inspiré de nombreux livres, films et documentaires, dont le plus célèbre est le film Titanic de James Cameron (1997), qui a relancé l'intérêt mondial pour cette tragédie. Des expéditions menées pour explorer l'épave, découverte en 1985, ont permis de reconstituer une grande partie de ce qui s’était passé cette nuit-là. Le Titanic est devenu un symbole de la vulnérabilité humaine face à la nature, mais aussi de la lutte pour la survie.

L'histoire d'une tragédie maritime

Le naufrage du Titanic reste l'une des tragédies maritimes les plus célèbres de l'histoire. Symbole d'une confiance aveugle en la technologie et en la modernité, il nous rappelle que même les plus grandes œuvres de l'humanité peuvent succomber face à la puissance implacable de la nature. Le Titanic n'était pas seulement un navire ; il représentait l'espoir, l'ambition et les rêves de milliers de personnes. Son naufrage, et les leçons apprises de cette catastrophe, ont profondément marqué l'histoire de la navigation et continuent d'inspirer de nombreuses générations.